元々は私の教会のブログに書いていた話です。

最近mayumiに「VR徘徊進めないと」とつつかれました。後で書くような事情があって必要だったのです。そこに「こんなエントリ書いたよー」とmayumiに見せたら「それ、むしろ会社のエントリでは?」とか言われたので、こっちにより詳しく書いておきます。

「その辺にあるもの」でやったことなので、そんなに高度な話でもないのですが、教会のブログに書けなかったようなあたりのことまで書いておこうと思います。

背景

私(生越)は教会で手話通訳しています。このことはしばしば書いてます。

私の所属する教会の教団(日本アセンブリーズ・オブ・ゴット教団)は、IT技術を使うことが是... と言うよりもむしろ推奨で、パワポとか使うのは当たり前。神学校(牧師の養成機関)の授業にはパワポの作り方はもちろん、動画編集とかの講義もあるそうです。実は牧師等にも元IT屋が結構多くて、仕事関係で調べ事をしていて読んだ論文の著者を「どこかで聞いた名前だな」と思ってよく調べたら、とある牧師が学生時代に書いたものだったということがあったり。教団名が長いので通称「アセンブリー教団」なんですが、アセンブラとは直接は関係ありません。

そういった背景がありコロナのこともあって、多くの教会がネット中継をするようになりました。私の教会も、コロナのごく初期からYouTube配信をしています。こういったことだとしばしば高齢者を置き去りにするという話が出がちなのですが、適当にサポートすることで90歳オーバーの人がネットで参加していたりします。この方が毎週教会に来るとなると大変ですから、むしろ高齢者のためになっているとも言えます。

YouTubeにも当然のように手話通訳をつけます。普段の礼拝にいなくても、ネット越しに見ている人は結構います。海外から見てる人もいます。普段来れない人が参加できるのは良いですね。とは言え、そんなに大きな教会(=信徒数が多い教会)ではないので、同時通訳ができる人は私を入れて3人くらいです。簡単に休むこともできません。

もちろん休まないに越したことはないのですが、それでも「やむをえず」ということは当然起こるわけです。代役が立てられればいいのですが、それが出来る時も出来ない時もあります。時々欠けるだけなら「よろしく」で済むのですが、割と起きるということとなってしまうと体制を考える必要があります。

ということで、「じゃあネット越しで通訳はできないか?」ということを考えたわけです。

当初の予定

当初は「VR徘徊」のPoCを教会に置いて音声と動画をネットで送り、それを元に通訳したものを送り返してOBSの入力にするつもりでした。

つまり、専用のデバイスを用意して音声と動画を得て、専用の通信チャネルで通信するということです。

これはいろんな理由がありますが、主には以下のような事情です

- 既存の中継設備にあまり手を入れたくない

専用のデバイスや箱をつなぐだけであれば、既存の中継設備そのままで出来ます(動画の入力チャネルには余裕があります) - レイテンシの管理がしやすいだろう

他人の作ったシステムだとこの辺が不透明です。うまく管理できればいいんですが - 視線が主体的に操作できる

「自分の都合」だけで映像も音声も用意できます

ちゃんと動けば、これがベストだと今も思っています。

そのつもりで色々やって来たのですが、ちょっと今ハードウェアをいじることが出来ない状態になっているので、VR徘徊の開発が続け辛い状態にあります。かと言ってタイムリミットがあったりもして、さてどうしたものかという状態だったわけです。

解決策

そこで教会の中継担当(彼女もIT屋)と考えたのが、Zoomを使ってやれないかということです。

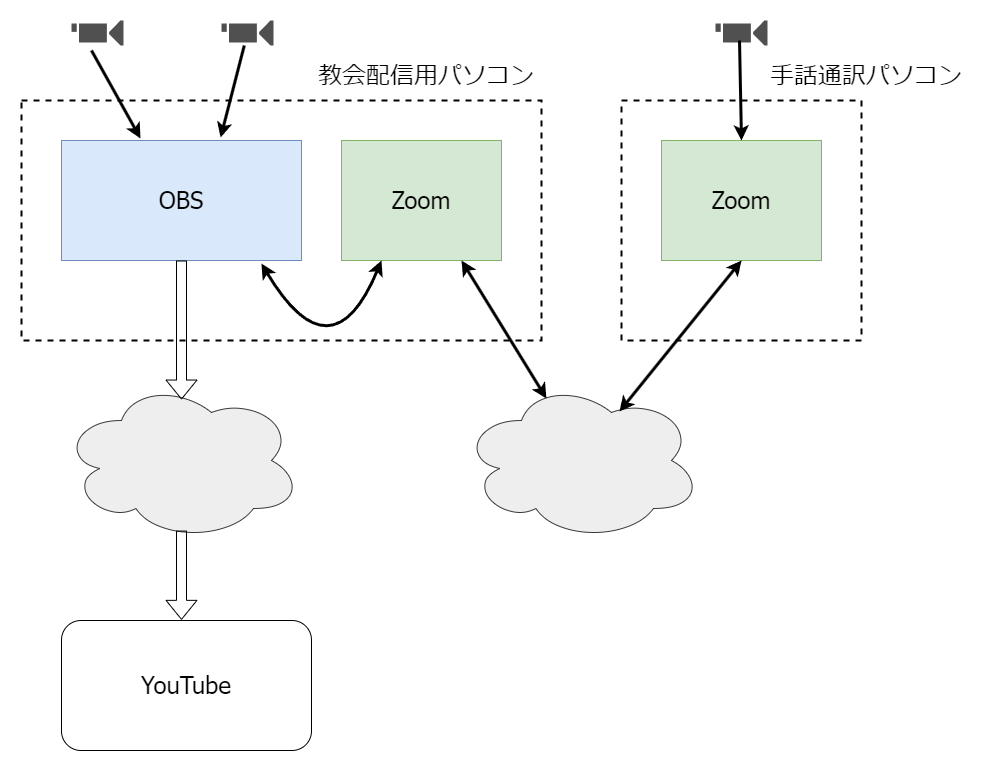

こんな構成です。

元々、教会の動画配信には基本的に4つの動画入力を使っていました。ちなみに、このシステム自体は私が構築しました。

- 主カメラ(HDMI)

講壇を主に写す4Kカメラです - 会衆カメラ(USB)

会衆席を写すカメラです - 手話カメラ(HDMI)

手話通訳者を写すSDカメラです - パソコンキャプチャ(HDMI)

パワポを出しているパソコンをキャプチャする入力です

このうち、3の手話カメラの代わりにZoomを使うわけです。

通訳者パソコンに送るための動画と音声は、YouTubeに送信しているものと同じものを使います。これはOBSは「中継開始ボタン」を押すと、仮想カメラもスタートするようになっていて、この仮想カメラは同じパソコンで動いている他のアプリのカメラ入力デバイスのふりをしてくれます。ですから、YouTubeで送信している動画をそのままZoomの入力にできます(カメラ選択で選ぶだけ)。

手話通訳者もYouTubeを見れば良いと思われるかも知れませんが、YouTubeのストリーミングのレイテンシは非常に長く、教会で使っている設定だと30秒程度遅れてしまいます。いくら手話が後追いでも構わないとは言え30秒も遅れると困るので、Zoomで送信することにしました。ちなみに、Zoomで送った時のレイテンシは1秒未満です。予備実験をした時の感覚だと「音速より速い」くらいでした。1階と2階に置いて予備実験をしたのですが、直接聞こえる音とパソコンから聞こえる音だとパソコンから聞こえる音の方が早い時もありました。これはもちろん通信状況に依存しますが。

通訳者を撮った映像は配信パソコンのZoomで見れますが、これはOBSにあるスクリーンキャプチャ機能を使って取り込みました。この辺は「配信」とかやってる人にはおなじみのことだと思います。

「ありもの」を使ったのは、それこそ「その辺のもの」で構成できるからです。特に手話通訳パソコンの方が簡単に出来ると、誰でも対応ができるようになります。VR徘徊のような専用システムでないメリットは大です。もちろん、うまく動いてくれればですけど。

結果

当初懸念していたのは、

- レイテンシは十分短いか

- 通信障害の影響はどうか

- スムーズにやれるのか

ということです。

レイテンシについては既に書いてしまっていますが、ほぼ無視できる程度です。特に私の通訳は「説教の時」ということにしたので、多分見ている人は全く気がつかない程度のレイテンシだと思います。まぁそもそも私の場合は「投機的」に通訳をしていて話してる人より一瞬早く通訳をしたりしているくらいなので、レイテンシは十分隠蔽できます。構成上自分がどう送信されているか見えるわけですが、それを見る限りでは違和感はありませんでした。

通信障害は時々発生します。障害と言うか、多分バンド幅が細くなったりするのでしょうね。これは情報量の多い音声、たとえば賛美(歌)の時にそうなりがちです。説教のように1人がしゃべっているだけの時はほぼ起きません。Zoomはその辺も最適化されているのでしょう(音声コーデックとはそういったもの)。私の通訳の間には起きませんでした。

全体にスムーズにやれるかということについては、事前に必要な設定をしたり予備実験したりしていたこともあって、特に大きな問題もなくできました。OBSはシーンのプリセットができますから、それをちゃんと用意しておけば事故さえ起きなければ問題とはならない感じです。

ポイント

OBSもZoomも「ありもの」なので、特に技術的な難しさはありません。やろうと思えば誰でも出来ることだと思います。

そこで敢えてポイント的なものを書いておくとするなら、

Zoomのバーチャル背景は使わない

といったことでしょうか。

バーチャル背景は便利なんですが、これは結構CPUを食います。そのため、古いノートPC(私はSurface Go)とかだと処理ができません。さらに他で試した経験だと、セグメント化処理は大変らしくて手話通訳のような極端に動きの早いものには追従が難しくなります。結果、うまく背景をすり替えることが出来ずに見辛いだけということになってしまいます。もちろん背景がうるさいと読み取りの時の障害になりますから、後ろに衝立を置いてすっきりさせました。

もう一つ挙げるとするなら、

通訳者は送られて来る自分を極力見ない

ということです。

いくらレイテンシが短いとは言え、自分の動作をネット1往復分遅れた動画で見ると、自分の意識している動きよりも遅れています。そうすると、頭が混乱してしまいます。どうしても見たければ、自分側の画像で見るのが良いと思います。

まとめ

こんな感じで「ありもの」でも結構いい感じのところまで行けることが実証できました。

これを応用すれば、手話通訳がよりカジュアルなものになって良いなぁという小並感です。

一時流行った「バーチャル宴会」よりもより客観的にレイテンシを評価することになったと思うのですが、思ったよりも短いということがわかったので、手話通訳以外にも使えるシーンは考えられますね。